产品 | 爱霏粒正式发布面向多模态大小模型的「向量数据库AIFOR VSearch V1.0」

爱霏粒Aiforia是一家专注认知智能技术创新,效率、创意与知识驱动的AI Agent产品公司,愿景是成为「最接地气的AI产品公司,做最感动人心的Agent产品」。

我们致力于在大模型为先的智能时代,将「高性能向量存储与检索」、「AI认知计算与决策智能」、「Agent云边融合操作系统」与「AI多模态交互」等多项独特AI技术,为机器智能构建「人」的全息数字化档案,面向空间智能、文化体训与心理咨询等三大应用领域,实现「人人轻松享有专属的专家服务」的未来愿景。

继十月份正式发布Agent操作系统「爱霏AIFOR V1.0」以来,爱霏粒Aiforia加快了AI Agent产品化的步伐。进入十二月,我们正式发布公司面向未来的第二个核心技术组件——面向多模态大小模型的「向量数据库AIFOR VSearch V1.0」。

同样的,公司清晰的产业链定位与产品战略,决定了「AIFOR VSearch V1.0」不对外独立销售,与Agent操作系统「爱霏AIFOR V1.0」等其他核心技术组件一样,被公司自有Agent产品集成来实现用户价值与商业变现。

我们将从以下四个方面说说面向多模态大小模型的「向量数据库AIFOR VSearch V1.0」是什么、为什么、做什么。

向量数据库背后的设计思想与方法论来源于两个学说:一个是概率论,一个是类脑学说。先说「概率论」,应该说,没有概率论以及概率论背后的思维革命,就没有数据驱动为核心特征的深度学习技术范式,更没有向量数据库这一回事。

从人类认知世界与改造世界的历史沿革来看,有两种主导思维革命的认知方法论:一是以牛顿方法论为核心的机械思维,二是以克劳修斯为核心的一种叫做熵的概率思维。

机械思维承认世界是确定的,有明确因果关系的,有了A必有B,因此世界的运行是精确可预测的;熵的概率思维,承认世界是不确定和无序的,强调用不确定性的眼光看待世界,有没有A不重要,有了B(结果与有效性)再反向寻找A(原因)。

能够通过因果关系找到答案固然最好,但这往往需要物质条件、天赋以及运气,比如牛顿定律的发现、青霉素的发明等。

但现实世界是高度不确定与复杂无序的,承认这种复杂性与不确定性,在大数据时代通过数据驱动的方法找到数据之间的强相关性,从而获得答案,往往比知道“原因”更有指导意义。这是一种新的世界观与思维方法。

其中结构化数据基于因果关系的机械思维,通过传统数据库的精准匹配获得正确的答案;而占比达80%而快速膨胀的非结构化数据蕴含着巨大的数据价值,如视频、音频、文本、图片等多媒体数据,我们有没有一种通用的计算方法与表现形式,将多样化的非结构化数据转化成通用的数据结构,从而挖掘出非结构化数据的核心价值?

这个通用的计算方法,就是以深度学习为代表的计算范式,通过模型对信息与知识完成高效压缩和总结;形成的通用的数据结构,我们称之为向量Embedding;基于概率思维寻找事物与事物的强相关性(所谓的答案),就可以通过通用数据结构的相似性计算与模糊匹配获得;而高效存储、检索与查询这类向量的数据库,我们称之为向量数据库。

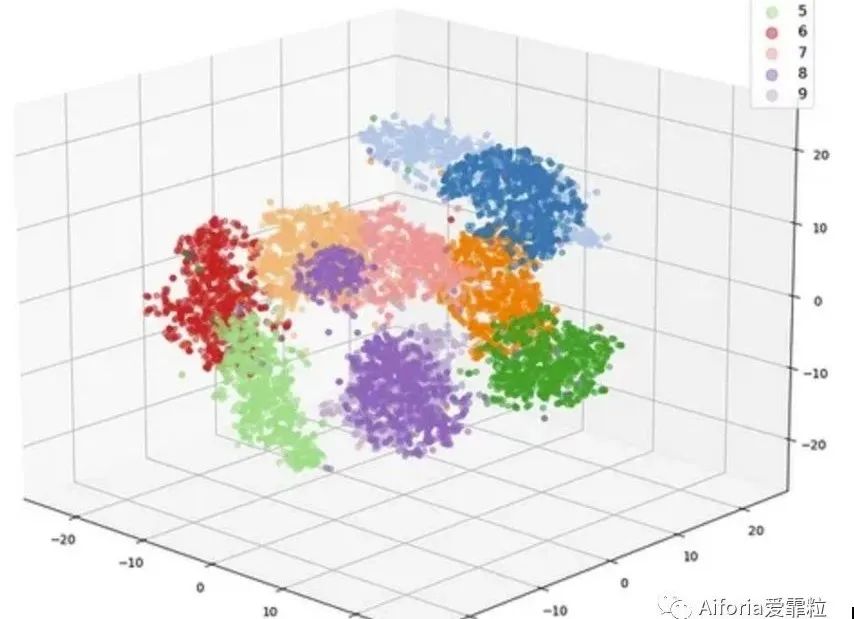

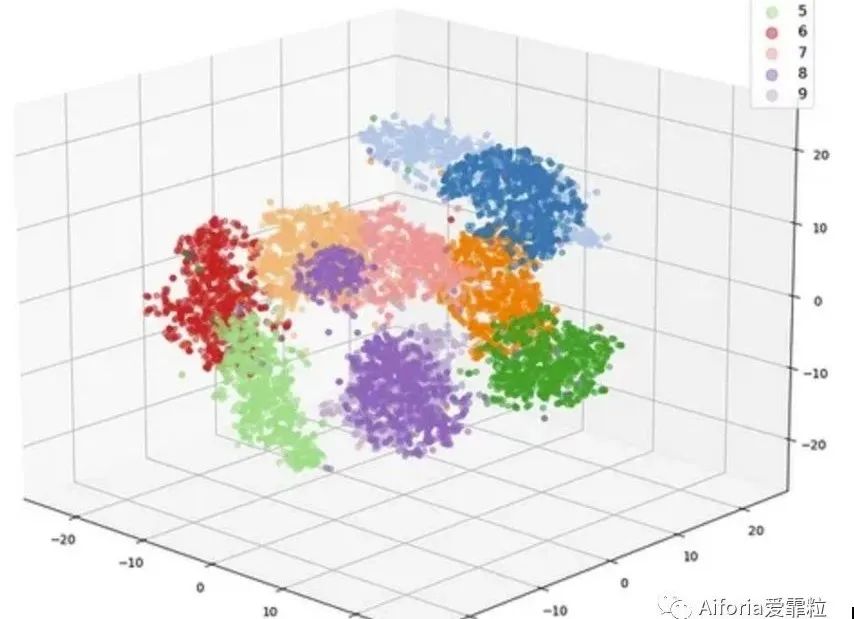

因此所有现实世界的知识与信息表达,都可以转化为统一的向量Embedding来表示,而向量空间拥有非常好的数学性质,通过在向量空间计算向量之间的相似性或者距离,来获取两个看上去不相关抽象概念之间的相关性。

总之,数智时代的一切智能化问题,都可以转化为统一的向量表示在向量空间的相似性计算问题,从而获得不同抽象概念的相关性。通过相关性计算消除世界不确定性与无序的过程,也即“对抗熵增即减熵”的过程。

而这一技术范式的核心,就指向了向量Embedding的相似性计算,和与之配套的高性能存储检索的物理承载——向量数据库。

1953年,15岁的莫莱森饱受癫痫发作的困扰,他接受了实验性的外科手术,医生切除了他部分内侧颞叶,包括海马体——这些区域被认为与癫痫发作有关。莫莱森的癫痫完全得到治愈,却以丧失记忆为代价,除了无法建立新的记忆能力,还无法设想未来。

他的不幸揭示了记忆背后的大脑运作机制:记忆的目的不光是记录以前发生的事情,还让我们能够设想未来——海马体可以重新组合来自过去的信息,将其组装成一幅未来的画面。

想要在伦敦从事出租车服务的司机,必须通过一项长达4年的强化培训,平均每天花费3~4小时记忆庞杂的道路、地标、兴趣点以及预设行程。研究海马体的一群神经科学家们事后发现,参加高强度记忆训练的出租车司机,其海马体体积明显比普通市民大了很多。

向量数据库,像极了碳基生命负责长期记忆的「海马体」。「类脑学说」给予我们启发,智能时代的向量数据库需要具备以下三项基本能力:进化的能力、设想未来的能力、类脑存储的能力。

-

进化能力强调的是「可塑性」。哺乳动物如海豚一生下来就会游泳,长颈鹿出生后几个小时就可站立,斑马出生几小时之后就可以奔跑。而人类需要漫长的环境适应与生活经历塑造,才能够获得独立生存的能力。正是因为人类大脑不做程序的预设,保留了足够的灵活性与可塑性,最后统治了地球。因此强大健壮的向量数据库不是「设计」出来的,而是根据环境需要「生长」出来的。

-

设想未来的能力强调的是「想象力」。大模型将人类的知识与经验实现高效压缩,内化到巨量的神经网络权重参数。但最大的问题是不可解释性。有没有可能将大模型重要的推理过程通过向量数据库保存下来,获得一定的可解释性?拥有一定的可解释性,就拥有了一定的想象力——根据环境的变化,通过神经网络权重参数的分化与组合,让大模型不通过人工训练而在人类的定义框架下自主生长?AutoGPT 做了很好的尝试,它会定期会记忆进行复盘,即通过对历史行为的反思形成经验,来决定接下来的执行计划。这与人类执行任务的思考方式异曲同工。AutoGPT因此 也成为了史上项目初期增长速度最快的项目之一。仅一个月的时间,其 star 数就超越了 Stable Diffusion ;最近其 star 数已经超越了 10万大关,接近Stable Diffusion 的两倍。

-

类脑存储的能力强调的是「记忆力」。你能够想象,基于大模型能力的数字助理如果缺乏记忆能力,是没有任何实用价值与情绪价值可言的。因此向量数据库让机器智能获得长期记忆能力,是一项最基础的能力。

爱霏粒将遵循这样的产品设计思想,这三项基础能力注入到向量数据库的长期迭代过程之中。

澄清几个对于大模型、Agent与向量数据库的认知误区。

生产场景的多样性与复杂性,决定了场景需求是分化的,对计算的需求一定也是分化的,分化的背后,是技术演变、生产成本以及资源配置效率共同造成的结果。计算的分化造成了高效压缩知识的模型一定不是唯一的,也一定不是以大为美的,未来将是大而强的大模型(多模态大模型,不仅自然语言理解与生成)、小而美的小模型混合发展的格局。

大模型火出圈之前,向量数据库存不存在?存在。有没有大规模的应用?有,在泛安防以及电商相似性搜索中已经大规模商业化落地。那为什么向量数据库就突然爆火了呢?一是资本推动,需要寻找新的故事线;二是LLM天然基于统计与概率,是不确定的,无法获得精确的、事实性的结果,因此容易出现幻觉的问题;三是受制于训练模型ROI与专有数据的隐私保护,LLM的知识更新以及私域数据保护的问题。

因此,在大模型为先的时代,能够同时低成本解决私有数据保护、知识更新、消除幻觉等问题,非向量数据库莫属。

第三个误区,向量数据库处于大模型公司的扫射范围内,会被大模型公司吞噬。

不会。原因很简单,经济成本、工程复用与数据资产问题。

第一,LLM是高效的知识压缩编码方式,如果将所有人类知识都内化到模型里面,神经网络会变得特别臃肿,导致训练成本、知识更新、运行响应都会是问题。参考计算机的发展过程,如果将LLM的神经网络参数比作CPU的片上存储ROM,那么向量数据库就是计算机的磁盘,而磁盘的存储成本远远低于片上存储的成本。从计算与存储的发展历史来看,通过存储空间换取计算效率,是效率与成本取得平衡的最佳方式。

第二,LLM读入无限的token,假以时日,技术肯定不是问题,但每一次执行都要将相关语料库不经过滤地作为promp输入时,工程复用性是很低的,会带来大量的资源浪费。

第三,拥有专有领域的私有数据商业公司,不会将数据资产交给大模型公司。向量数据库私有化部署是大的趋势。

因此,爱霏粒对Agent智能体、大模型以及向量数据库之间协同关系的认知和别人不同。用一个简明的等式表达如下:

AI Agent(AI Native,非LLM Native)= 人机协同(多模态交互的决策范式)+ 认知计算(大小模型混合发展的工程范式)+ 向量数据库(进化的能力、设想未来的能力、类脑存储的能力)+ Agent操作系统(云边协同、资源调度与优化配置)

下面是广告时间。爱霏粒AIFOR Vsearch V1.0的特性包括如下几个方面:

-

真正开放、兼容主主流Embedding模型厂商的向量数据库

-

支持十亿级别的向量搜索,核心算法提供了 异构计算的实现

-

把精确解的暴力搜索,变成了近似解的搜索,并且用一定的预处理计算量构建索引,在进行检索前利用索引降低检索范围或者是计算量以此实现加速

-

-

检索引擎包含四个关键技术组件:特征提取、距离度量、检索算法、向量存储

-

向量距离度量采用多种相似性比较函数:欧式距离、余弦距离、内积距离、海明距离等,不同的度量方式对应不同的场景。

首页

ꄲ

产品方案

ꄲ

产品 | 爱霏粒正式发布面向多模态大小模型的「向量数据库AIFOR VSearch V1.0」